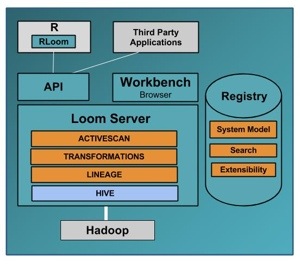

Je moet dat filesysteem wel vullen. Dat kan je ook doen met Hive, met bijvoorbeeld een CREATE table. (Zie Hive DDL). De data verdwijnt in een directory van het Hadoop File systeem, en Hive houdt een definitie voor je vast. Maar hoe houd je bij waar de originele data vandaan komt, en hoe weet je of de geladen data actueel is? Dat houdt Hive niet voor je bij. En als je een analyse doet op de data, dan is het wel zo prettig als je kan aantonen waar de data vandaan komt (lineage). En zo ontstaat er een datamanagement uitdaging. En in dat gat springen dan weer leveranciers. Een voorbeeld is Revelytix, dat met Loom een geheugen bijhoudt van dataset, jobs en queries.

Een heel ander voorbeeld is GlobalIDS, welke een soort van Master Data Management biedt over al je databronnen, inclusief Hadoop file systemen.

Kortom, met alleen een Hadoop implementatie ben je er nog niet.